摘要: 车内人机交互(HMI)系统已经发展成为汽车必备的一个“零件”。作为计算机科学、行为科学以及其他几个研究领域的交汇处,车内HMI在实际应用领域中具有巨大的潜在价值。然而,现有的HMI交互内容大部分为指令或者公共数据等不涉及到驾驶员和驾驶数据,造成了HMI在个性化服务上的数据缺失问题。因此,本文构建了行车历史数据提取模型,通过真实环境下的行车视频数据,提取出与行车过程中有联系的目标集合以及目标对应的时间集合和位置集合,最后将提取出的数据持久化到本地。除此之外,本文设计的性能测试实验证明了此模型技术方案的可行性和准确性。

Abstract:

In-vehicle Human-Machine Interaction (HMI) system has developed into an essential “part” of the car. As the intersection of computer science, behavioral science, and several other research fields, in-vehicle HMI has great potential value in the field of practical application. However, most of the existing HMI interaction content is instructions or public data, which does not involve the driver and driving data, resulting in the lack of data in the personalized service of HMI. Therefore, this paper constructs a driving history data extraction model. Through the driving video data in the real environment, the target set related to the driving process and the time set and location set corresponding to the target are extracted, and finally the extracted data is persisted to local. In addition, the performance test experiment designed in this paper proves the feasibility and accuracy of the technical solution of this model.

1. 引言

自计算机诞生以来,人机交互系统也随之得以兴起。在现实生活中,只要有计算机等通讯信息技术的使用,人机交互就永远是人类不老的话题。车内人机交互系统就是人机交互的一个分支,简单来说,车内人机交互系统就是人与汽车通过一定的交互方式完成信息交换的过程,它能够直接影响用户的用车体验。然而现有交互系统的交互内容大部分为指令数据或者公共数据等形式,不涉及驾驶数据和行车数据,因此造成了车内交互系统提供个性化服务上的数据缺失问题。

随着用户在汽车行业消费观念的转变,除了自动驾驶、智能化座舱、新能源等服务功能,对车内人机交互系统的需求也日益激增。国外的汽车行业最早可以追溯到1885年,其人机交互系统体验和服务较为完善 [1] 。例如特斯拉汽车上的物理按键非常少,一般放在方向盘上或方向盘附近。这些物理按键主要用来控制巡航、自动化驾驶、刮水器以及照明灯等功能。但是大多数辅助功能都没有专门的物理控件。奔驰汽车 [2] 可以为用户提供更智能化的驾驶体验,例如:根据驾驶者身材比例为其调整适合的后视镜角度和座椅位置、实时监测驾驶员操作动作等。虽然国产汽车起步较晚,但是也有很多互联网企业、高校和汽车制造商进行合作开展了相关研究。到目前为止,国产车在国民心中已经有了举足轻重的地位。蔚来汽车的Aspen系统搭载了NOMI人工智能管家,它拥有超强的学习能力和语音指令识别等,值得一提的是还可以在操作台上方的显示屏中显示出多种情感的表情,就好像它是有生命的管家一样。理想AD Max系统以“一切为了安全”为研发的基本原则。为了应对遭遇强光或者黑暗环境时,摄像头的能力会大打折扣,在BEV视觉信息为主的基础上,增加了激光雷达和高精地图的信息作为辅助,独创了BEV融合算法。为进一步加强安全性,还加入了视觉安全模块和激光雷达安全模块,与BEV框架模型互为冗余,能在极限环境下为安全提供多一层保障。

综上所述,国内外对车内交互系统的个性化服务研究还处在初期阶段。因此,本文提出了一个行车历史数据提取模型,用来将行车过程中与行车有关联的目标集合、时间集合以及位置集合存储到本地,为提供个性化服务提供底层数据。此外,为了评估此模型,本文通过行车记录仪录制了累计28小时的真实环境下的行车视频并设置了性能测试实验,证实了本文所提模型的有效性和准确性。

2. 行车历史数据提取模型

2.1. 模型总体框架

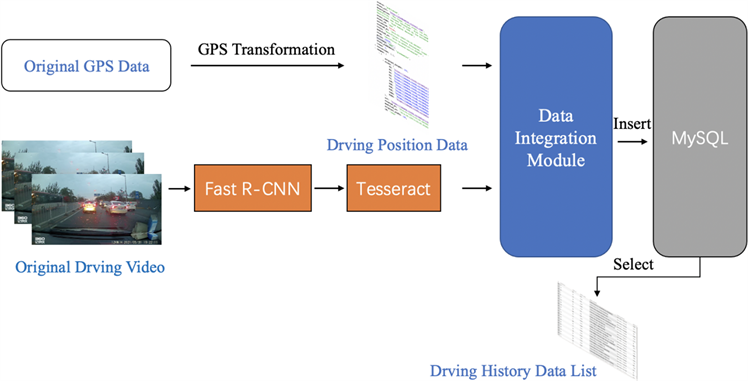

如图1所示,本文所提出的模型主要分为4个模块:GPS数据解析模块、目标集合以及时间信息提取模块、数据整合模块以及数据持久化模块。以下将对各个模块进行详细介绍。

Figure 1. Model overall framework diagram

图1. 模型总体框架图

2.2. GPS数据解析模块

由于行车记录仪提供的位置数据信息为GPX格式,这是一种基于XML的轨道格式,也是GPS数据通用的一种规范格式。如图2所示,其中红色框里的数据表示经纬度信息,绿色框里的数据表示格林尼治时间,因此需要将二者解析为对应的地址以及对应的北京时间。在这里需要用到gpxpy工具,该工具是一个简单的Python库,用于解析和操作GPX格式文件。

首先本文使用gpxpy工具将原始的GPS数据解析为经纬度集合

以及格林尼治时间集合

。然后使用百度地图提供的API将经纬度集合转化为中国地图中实际的位置信息

,另外格林尼治时间集合中的数据需要加8小时转为北京时间集合

,最后将转化好的位置数据和时间数据存储为json格式供后续使用。解析完后的数据如图3所示。

2.3. 目标集合以及时间信息提取模块

考虑到历史数据提取任务的需求,目标集合

的提取是本模型中最重要的一个部分,因此一个好的目标检测方法起着至关重要的作用。在本文中选用了Fast R-CNN [3] 作为获取目标集合的网络模型,并只保留了置信度大于0.8的目标。由于轿车和行人两类目标频繁出现,因此本文剔除了这两类目标。

为了更好的获得目标集合中检测到每个目标时的时间信息,本文在检测目标的同时记录了检测到该目标时的帧数信息集合

。由于行车视频的右下角提供了北京时间信息,并且没有任何遮挡以及扭曲,如图4所示。因此本文首先将包含时间信息的图像区域裁剪下来,得到待提取时间信息的图像集合

。最后使用Tesseract [4] 工具进行图片上的光学字符识别得到检测到该目标时的时间数据集合

。该工具是Google开发的一个基于LSTM [5] 的OCR模型,具备良好的性能。

2.4. 数据整合模块

该模块负责将所有需要持久化存储的数据进行整合。首先本文将时间集合中的数据与解析出的GPS数据中的北京时间数据集合相匹配,得到检测到每个目标时的位置信息

。时间匹配算法伪代码如图5所示。最终整合这些数据,得到需要持久化存储的数据集合

。

Figure 5. Pseudocode of time matching algorithm

图5. 时间匹配算法伪代码

2.5. 数据持久化模块

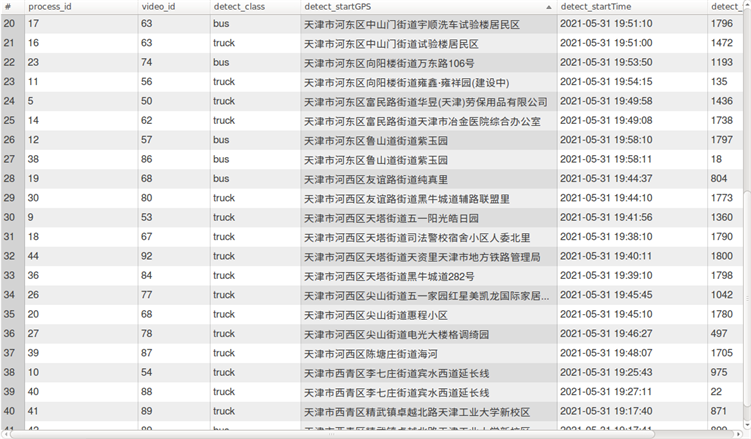

该模块负责将整合好的数据持久化到MySQL [6] 数据库中,结果如图6所示。本文设计了两张数据库表用来分别用来存储行车视频信息以及检测出的数据集合信息。表结构如表1,表2所示。

Figure 6. Driving history data storage map

图6. 行车历史数据存储图

视频存储表用于存储行车视频相关信息,而视频处理表用于存储在2.4节整合好的四个数据集合信息,两张表通过video_id外键相关联。

3. 实验结果分析

为了更好的评估本文提出的模型,本文在真实的车辆上安装了行车记录仪来采集真实环境中的行车视频数据,如图7所示。行车记录仪品牌为第一现场,型号D-269PRO,前置录像画面视角为170˚,视频分辨率为1080P,运行内存为1 GB。该设备每隔3s会记录一次行车位置并且具有夜间录像补光功能。本文录制的行车视频数据累计28小时,包含了白天以及晚上的行车视频。

Figure 7. Driving recorder installation location

图7. 行车记录仪安装位置

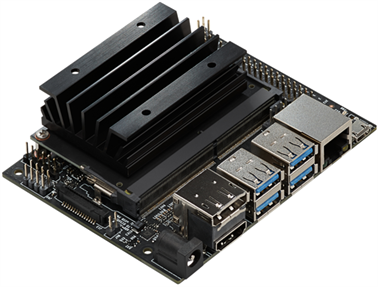

本文采用了Nvidia Jetson Nano [7] 开发者套件作为开发平台,该设备是一款专为创客、学习者和开发者打造的小型AI计算机,如图8所示。Jetson Nano使用了四核64位ARM CPU与128核集成Nvidia GPU,达到了472 GFLOPS的计算性能。并且Jetson Nano附带的Nvidia TensorRT [8] 加速器库在多种场景下都极具实时性。

Figure 8. Jetson Nano developer kit

图8. Jetson Nano开发者套件

为了对该模型进行性能评估,本文进行了5次性能测试。每次测试保证只有该模型在运行,没有其他因素影响性能测试,例如:其他应用占用CPU资源或者GPU显存。实验结果为5次性能测试结果的平均值。详情见表3。

Table 3. Performance test experiment results

表3. 性能测试实验结果

从表3的实验结果可以看出,系统运行平均帧率为5.45,对于Jetson Nano小型计算机来说,已经达到了一个可观的性能。除此之外,响应时间达到120.3 ms,证明可以达到用户的等待范围,提供一个良好的交互能力;CPU占用率为43.3%,证明可以轻松运行并处理当前运行的程序或者后台;内存使用率为68.3%,证明还有充分的内存空间来处理其他任务;错误率只有7.3%,证明本模型的准确性。综上所述,本文所提出的模型解决了历史数据提取任务,并且性能测试结果证明了其可行性。

4. 结论

本文为车内人机交互系统设计了一个行车历史数据提取模型,目的是解决车内HMI在提供个性化服务上的数据缺失问题。其次,为了验证所提出的模型,本文介绍了行车视频数据的采集以及性能实验所采用的硬件环境及软件环境。最后性能实验的结果证明了本文所提出的行车历史数据提取模型的可行性以及准确性,为后续研究提供了理论基础和技术支持。