1. 引言

在自动驾驶汽车智能化、联网化的大趋势下,自动驾驶技术逐渐成为新时代智能、交通等领域的研究重点。随着自动驾驶技术的不断研究深入与智能汽车标准规范化的增强,高精地图作为自动驾驶技术的关键一环,发挥了不可忽视的作用。

传统电子地图(Electronic Map),即将传统纸质地图电子化,通过计算机系统表示各类地图信息。同时可以通过计算机系统实现实时准确将用户所需的时空信息传递给用户。目前市面上应用广泛的电子地图如高德地图、百度地图等,主要服务对象为出行人群,通过行人自有的逻辑判断实现导航功能。但由于自动驾驶技术的所需地图要求地图精度更高,地图维度更多等特点,传统导航电子地图无法满足自动驾驶技术对于导航地图的需求。因此针对于自动驾驶技术的高精地图被提出,其以更高的精度、更为详细的地图要素服务于自动驾驶领域。

高精地图(High Precision Map) [1] 指精细且精度高的地图。相对于传统电子地图而言,具有精度高、面向计算机系统、地图信息更详细丰富的特点。一方面,高精地图的精度可以达到厘米级;另一方面作为不面向于驾驶员只面向电脑的地图,高精地图不仅包括了传统电子地图的坐标、道路等信息,还包含了道路形状、车道线、车道中心线、行人、交通标识等信息。因此高精地图能够更好地满足自动驾驶技术的需要。

自动驾驶高精地图数据集作为高精地图基础,有着提供自动驾驶技术所需的高精地图的关键作用。目前对于高精度地图数据集的研究有很多,例如KITTI [2]、Cityscape [3]、Argoverse [4]、Oxford’s Robotic Car [5]、ApolloScape [6]、nuScenes [7]、BDD100K [8] 等数据集,不同高精度地图数据集包括多种驾驶环境、适用对象,包括白天、夜间、雨雪、大雾沙尘暴等环境。综上所述单一的高精地图数据集显然无法满足多种驾驶环境地图数据需求。且对现市面上主流的几大高精度地图数据集没有较为系统准确的归纳整理。因此对于不同高精地图数据集的分析对比对于满足不同的驾驶环境需求便显得尤为重要,本文针对于上述提到问题,对几大主流高精度数据集进行对比归纳。

2. 常见高精地图数据集内容

目前市面上高精地图数据集种类众多,涉及范围较广,因此本章根据发布年份、应用领域、知名程度等多方面选取KITTI、Cityscape、Argoverse、Oxford’s Robotic Car、ApolloScape、nuScenes、BDD100K七个常见高精地图数据集作为本文研究代表进行简要介绍并在第三章进行简要分析。

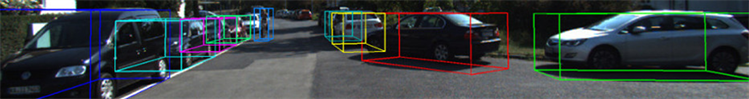

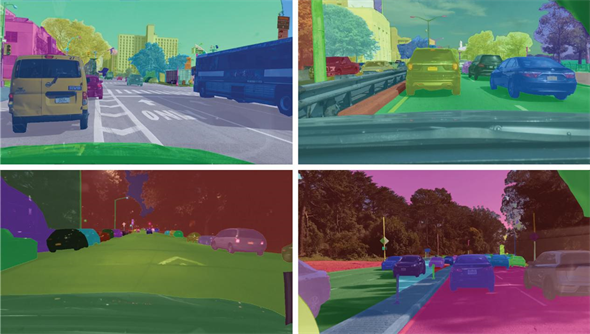

1) KITTI数据集是一个应用于自动驾驶场景下的计算机视觉算法评测数据集。KITTI数据集2012年由德国卡尔斯鲁厄理工学院(KIT)和丰田美国技术研究院(TTIC)联合创办,是目前国际上最大的自动驾驶场景下的计算机视觉算法评测数据集(如图1所示)。

Figure 1. Part of the data of the KITTI dataset

图1. KITTI数据集部分数据

2) Cityscape是一个面向城市道路街景语义理解的数据集,其主要应用于图像语义分割(像素分割、实例分割)。数据集涵盖场景包括50个城市不同情况下的街景以及30类物体标注,时间跨度长,主要影像时段为白天、天气以良好/中等天气条件为主(如图2所示)。

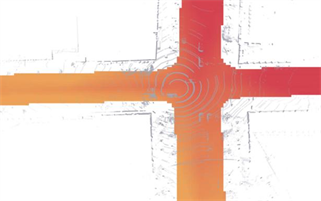

3) Argoverse是由Argo AI、卡内基梅隆大学、佐治亚理工学院联合发布的包含三种不同类型数据的高精地图数据集,主要来自Argo AI的自动驾驶测试车在迈阿密和匹兹堡数据采集区域(如图3所示)。

Figure 3. Raster and vector data maps collected in Pittsburgh and Miami

图3. 在匹兹堡和迈阿密采集的光栅和矢量数据图

4) Oxford Radar RobotCar是RobotCar数据集的雷达扩展数据集。其传感器模式是由CTS350-X毫米波FMCW雷达和双Velodyne HDL-32E激光雷达与优化地面实况雷达组成,通过观测英国牛津中部的一条路线(如图4所示)。

5) 百度启动Apollo (阿波罗)项目,而作为阿波罗项目的关键一环,ApolloScape于2018年创立。

ApolloScape由仿真数据集、演示数据集和标注数据集组成。目前数据体积已经开放14.7万帧的像素级语义标注图像、80k激光雷达点云数据和1000 km城市交通轨迹数据(如图5所示)。

Figure 4. Screenshot of part of Oxford’s Robotic Car dataset

图4. Oxford’s Robotic Car数据集部分数据截图

Figure 5. Partial data example diagram of ApolloScape dataset

图5. ApolloScape数据集部分数据实例图

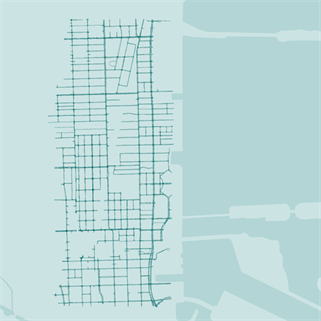

6) nuScenes数据集是由自动驾驶公司nuTonomy建立的具有3d对象注释的自动驾驶数据集,该数据集不仅包含了相机图像和激光雷达扫描数据,还记录了雷达数据,是少数含有雷达数据的数据集。nuScenes数据集由1000个场景组成(即scenes,这就是该数据集名字的由来)。nuScenes数据集包含 1,400,000张相机图像和390,000次激光雷达扫描,140万个3D边界框和23个对象类手动注释。数据采集地点覆盖了波士顿和新加坡两个城市(如图6所示)。

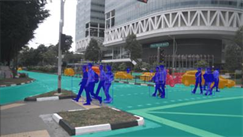

7) BDD100K数据集由加州大学伯克利分校于2018年发布,是迄今为止最大规模,内容最为丰富多样的自动驾驶数据集之一。BDD100K数据集由超过100K的视频和各种注释组成,包括美国各个地区如纽约、伯克利、旧金山等地的不同时间、天气条件和驾驶场景的数据(如图7所示)。

Figure 6. Partial data example diagram of nuScenes dataset

图6. nuScenes数据集数据可视化图

Figure 7. The drivable area map of the BDD100K dataset

图7. BDD100K数据集可行驶区域图

3. 常见数据集对比分析

针对于目前自动驾驶领域高精地图数据集众多,暂无较为明确的对比分析。自动驾驶领域研究主要对于自动驾驶车辆的目标检测技术进行改进,因此对于高精地图数据集的选择注重于对于数据集的识别目标。同时为了满足多种驾驶环境和重复多次的测试,数据集的驾驶环境与数据规模也同样尤为重要。并且本文对于当前常见数据集的应用研究领域进行初步统计,以便于后续研究的利用应用。因此本文综合统计分析第二章节提到的7个高精地图数据集,,分别从识别目标、驾驶环境、数据规模、应用领域四个方面进行量化统计与分析,并对量化分析结果进行总结。

3.1. 识别目标分析

自动驾驶领域识别对象主要包括道路要素、机动车、行人。常见的数据集有KITTI数据集、Argoverse数据集和BDD100K数据集等。

KIITI数据集作为目前国际上最大的自动驾驶场景下的计算机视觉算法评测数据集,每张图像中最多达15辆机动车和30个行人,还有不同程度的遮挡与截断。其识别目标主要集中于机动车与行人,有助于对于车辆和行人的目标识别实验。

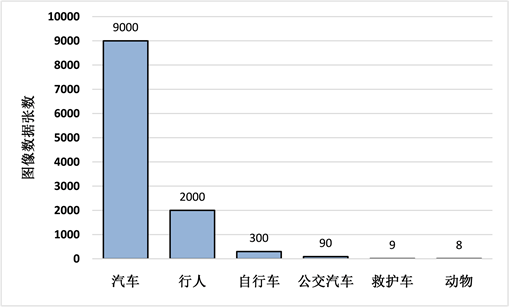

Argoverse数据集相较于KITTI数据集单一的汽车识别目标类别,对于识别目标中的机动车进行了更为细致的分类,主要分为汽车、自行车、救护车、公交车等多种车辆(图8),适用于对不同类别运动物体识别检测的研究(如图8所示)。

Figure 8. Argoverse dataset target detection composition diagram

图8. Argoverse数据集目标检测构成图

BDD100K数据集则不同于上述两类数据集,不仅仅限于运动物体目标识别,同时还对车辆行驶区域内的交通标志、交通障碍和车道线(车道实线、虚线、双线、单线)等要素进行识别。

3.2. 驾驶环境分析

数据采集的周边场景以及天气条件是自动驾驶领域进行数据集选择测试的重要因素之一。常见的具有代表性的不同识别环境数据集有KITTI、Oxford’s Robotic Car等数据集。

KITT数据集数据场景主要包括城镇、乡村和高速公路等场景(如图9所示),具有较高适用性。Oxford’s Robotic Car数据集采集地点为英国牛津固定道路,数据场景为单一公路,对于需要固定场景大量重复实验的自动驾驶实验有较好实验效果。

Figure 9. Distribution map of driving environment in KITTI dataset

图9. KITTI数据集驾驶场景分布图

天气条件方面,KITTI数据集主要为光照条件较好的晴天,不适用于多种环境条件下的自动驾驶研究;Oxford’s Robotic Car数据集天气条件丰富(如图10所示),不仅包括常规的晴天,还包括阴天、雨雪天气和夜间环境等,对于不同环境下的自动驾驶实验具有较高的适应性。

Figure 10. Distribution map of weather conditions for Oxford’s Robotic Car dataset

图10. Oxford’s Robotic Car数据集天气条件分布图

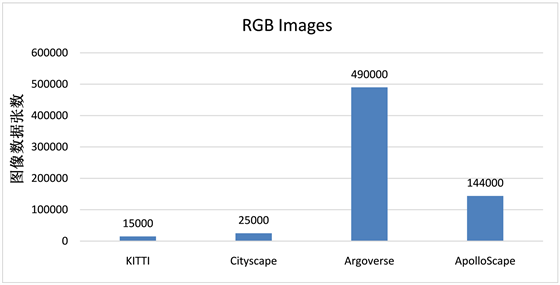

3.3. 数据规模分析

本节以第二章中的七种主流数据集为例,通过统计其数据量大小、样本数量,对主流数据集进行分析。

早期高精地图数据集主要由立体图像和视频组成,如KITTI数据集,数据量较小,一般为几十到几百K,且集中于运动物体,对于自动驾驶场景中其他固定要素采集较少(如图11所示)。而在近些年来,随着采集技术和设备的升级,一些较新的数据集,如BDD100K、Nuscenes数据集等,数据量逐渐增多,采集数据类型也不仅限于运动物体,还包括了建筑物、交通要素、车道线等固定数据。其数据类型也呈多样化趋势(如图12所示)。

Figure 11. Data volume map of early high-precision map datasets

图11. 早期高精地图数据集数据量图

Figure 12. Data volume map of recent high-precision map datasets

图12. 近期高精地图数据集数据量图

3.4. 应用领域分析

本节通过查阅相关文献,挑选7种主流自动驾驶数据集中应用研究最为广泛的三类数据集进行总结分析。

KITTI数据集主要应用于自动驾驶领域计算机视觉检测,王林等人以Faster R-CNN模型为基础利用KITTI数据集对深度神经网络模型进行训练,能够自动地提取车辆特征 [9]。张富凯等人基于改进YOLOv3,在KITTI数据集实验后实现城市交通监控中不同类型车辆的实时检测 [10]。

Cityscape数据集由一系列欧洲街道影像构成,主要应用于语义分割技术,王晨等人基于深度卷积神经网络对Cityscape数据集上进行有监督学习并达到了0.052 s每帧的运行速度以及75.2%平均交并比的分割精度 [11]。杨威等人使用Cityscapes数据集作为训练样本,分别使用交叉熵和Focal Loss作为损失函数来对模型进行训练 [12]。

BDD100K数据集不仅包括图像和视频,还涵盖了雷达数据,被广泛应用于道路检测领域。孙迎春等人通过优化YOLOv3算法对交通灯进行检测,并在BDD100K数据集上进行试验 [13]。

3.5. 量化分析结果

本节基于上述的识别目标、识别环境、数据规模、应用领域方面的量化分析结果进行了归纳整理得到表1如下。

由上述对比分析可以得出,从识别目标来看,以KITTI数据集为代表的主流数据集主要以汽车和行人为主要识别目标,而以Argoverse数据集和BDD100K数据集为代表的新兴数据集,分别对于某一类目标例如机动车进行更为细致的分类识别和在广度上包含更多角度的识别类别例如车道线、交通要素等;从驾驶环境来看,常见高精地图数据集主要在光照条件充足的天气下进行,而驾驶场景则是涉及城市、高速公路和学校等多种场景,其中以KITTI和Oxford’s Robotic Car数据集为主要代表;从数据规模来看,随着采集设备的更新,自动驾驶精度和可靠性要求的提高,高精地图数据集的数据规模也随之增大,由早期的KITTI数据集几十到几百K数据量,数据内容单一到现在BDD100K几百M数据量,数据内容丰富多样;从应用领域来看,对于数据集的应用主要针对于影像图像、语义分割、雷达分析等多种领域。

同时根据表1可以补充得出其他方面结论,在需对多个城市进行自动驾驶数据测试时,可以选择Cityscapes、ApolloScape数据集,其中ApolloScape主要为国内城市,而Cityscapes则多为国外城市;需要大量数据进行自动驾驶的测试,可以选择BDD100K、Oxford’s Robotic Car数据集,其中Oxford’s Robotic Car为重复路线数据,而BDD100K则为不同区域数据;需使用大量激光雷达和雷达数据进行的测试,可以选择Nuscenes数据集;需应用较早的高精地图数据的测试可以选择KITTI数据集,如需应用最新发布数据则可以选择Argoverse和Nuscenes数据集;其中绝大部分数据集可以应用于光照条件较差的自动驾驶环境测试。

Table 1. Main dataset analysis comparison table

表1. 主流数据集分析对比表

4. 总结与展望

自动驾驶领域近年来得到快速发展,作为自动驾驶基础的高精地图显得尤为重要,由于高精地图诞生较晚,发展迅猛,尚未有足够研究关于主流高精地图数据集的统计分析。因此本文通过对市面上几类主流和新兴高精地图数据集进行归纳分析,并从识别目标、识别环境、数据规模、应用领域方面进行量化分析,并简要归纳总结各大数据集主要参数、适用领域和存在不足。为高精地图生产从业者提供一定参考,并且对于自动驾驶工作者对于数据集研究及应用提供参考。本文下一步工作将从两方面继续开展,一方面是对于高精地图数据集的广度,进一步扩充不同类型高精地图数据集的量化分析;另一方面则是加深高精地图数据集的深度,针对于现存主流数据集深入研究其多方向应用。